安装大模型 UI 界面 OpenWebUI

功能介绍

OpenWebUI 是一个可扩展、功能丰富且用户友好的自托管 AI 平台,旨在完全离线运行。它支持各种 LLM 运行器(如 Ollama)和与 OpenAI 兼容的 API,并内置了 RAG 推理引擎,使其成为强大的 AI 部署解决方案。

安装应用

shell

conda create -n open-webui python=3.11 -y

conda activate open-webui

pip install open-webuipython3.11 是 OpenWebUI 官方推荐 python 版本

更新 open-webui 命令

shell

pip install --upgrade open-webui开始使用

启动 OpenWebUI

shell

open-webui serve注意:如果想让 OpenWebUI 完全离线运行而不去尝试从网络上下载模型,设置如下参数:set HF_HUB_OFFLINE=1

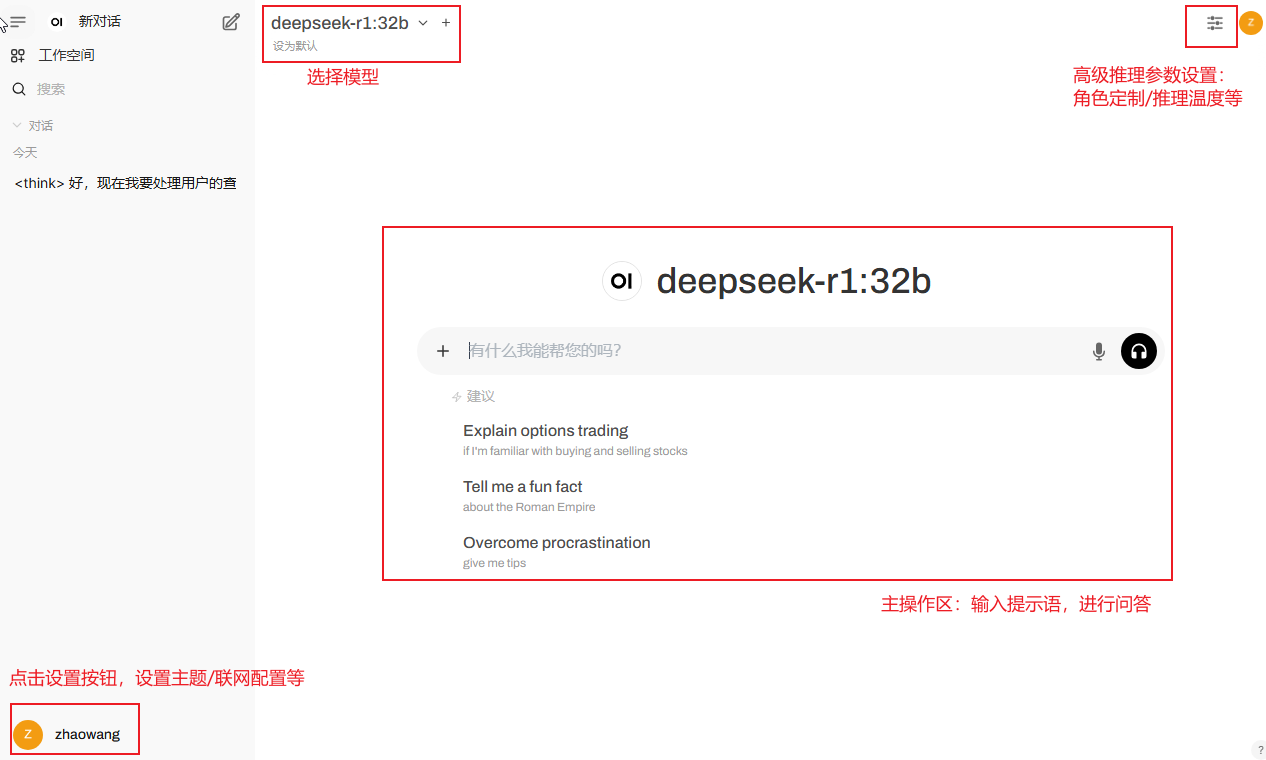

后续在操作界面选择模型,进行问答即可。

OpenWebUI 集成 Ollama

官方介绍,启动 Ollama 实例,之后启动 OpenWebUI,它将自动尝试连接到您的 Ollama 实例。

OpenWebUI 集成 OpenAI 类接口

OpenWebUI 集成 MCP 服务

安装 mcpo,mcpo 是一个将 mcp 服务转换为 openAPI 的代理服务。

shell

pip install mcpo文章的最后,如果您觉得本文对您有用,请打赏一杯咖啡!感谢!